Dlaczego temat bezpieczeństwa w generatorach obrazów AI w ogóle ma znaczenie

Generator obrazów AI stał się normalnym narzędziem pracy: przyspiesza tworzenie moodboardów, grafik do social mediów, miniaturek do wideo, slajdów do prezentacji czy nawet szkiców koncepcji dla klientów. To już nie “magia z internetu”, tylko realny element workflow kreatywnego – tak jak Photoshop czy Canva.

Wraz z tym wchodzi jednak cały pakiet ryzyk: od sporów o prawa autorskie, przez naruszenie wizerunku, po zwykłe nieporozumienia z klientami, którzy nie zawsze wiedzą, że część ich kampanii powstała z użyciem AI. Jedna niefortunna grafika może uruchomić lawinę problemów: zablokowaną kampanię, utratę klienta lub niewygodne pytania działu prawnego.

Konflikty wynikają często nie ze złej woli, ale z braku procedur i nawyków. Ktoś “na szybko” wygeneruje ilustrację do posta, nie doczyta regulaminu narzędzia, powtórzy elementy podobne do znanej marki i nagle okazuje się, że grafika łudząco przypomina kampanię konkurencji. Klient jest zachwycony szybkością, dopóki jego prawnik nie zauważy “inspiracji”.

Istnieje ogromna różnica między luźnym “pobawmy się AI i zobaczmy, co wyjdzie” a odpowiedzialnym korzystaniem z tych samych narzędzi w projektach, za które ktoś płaci i które reprezentują markę. W pierwszym przypadku najwyżej usuniesz plik. W drugim – możesz mierzyć się z reklamacją, korektą umowy albo zablokowaną emisją reklamy.

Bezpieczne korzystanie z generatorów obrazów AI w pracy twórczej sprowadza się więc do jednego: świadomego ustawienia zasad gry. Zamiast bać się AI albo udawać, że problemu nie ma, lepiej zbudować prosty system decyzji: co, gdzie, jak i w jaki sposób generujesz – oraz jak to dokumentujesz.

Podstawy: jak działają generatory obrazów i jakie to ma skutki prawne i praktyczne

Co robi model generatywny z obrazami treningowymi

Modele generujące obrazy (Midjourney, DALL·E, Stable Diffusion i podobne) uczą się na gigantycznych zbiorach danych: obrazach i opisach tekstowych. Na etapie trenowania model “patrzy” na setki milionów przykładów i uczy się zależności typu: jak wygląda pies, jak rozkłada się światło na twarzy, jak prezentuje się produkt w packshotcie.

Technicznie model nie przechowuje w pamięci konkretnych plików jak dysk twardy. Zamiast tego zapisuje abstrakcyjne wzorce, rozkład cech i powiązania. Dzięki temu jest w stanie generować nowe, unikalne obrazy kombinując te wzorce na niezliczone sposoby. To jednak nie znaczy, że ryzyko kopiowania jest zerowe.

W pewnych sytuacjach – szczególnie przy bardzo charakterystycznych stylach, znakach towarowych lub specyficznych układach – model może wygenerować coś bardzo podobnego do materiałów treningowych. Dzieje się tak zwłaszcza wtedy, gdy prompt jest precyzyjnie skierowany na konkretny styl (“in the style of X”) albo gdy w zbiorze danych było mało przykładów, ale mocno powtarzalnych.

Z praktycznego punktu widzenia ważne jest jedno: generatory obrazów AI nie działają jak kopiuj-wklej, ale potrafią zbliżyć się do czyjegoś stylu na tyle, że powstaje pytanie o naruszenie praw autorskich lub co najmniej o etykę takiego wykorzystania. W biznesie “bardzo podobne” często jest już wystarczająco problematyczne.

Skąd biorą się problemy z prawami autorskimi

Prawo na świecie nie nadąża za technologią generatywną. Brakuje jednolitych zasad, a różnice między USA, UE i innymi jurysdykcjami są spore. W wielu krajach obraz wygenerowany w całości przez AI nie jest objęty klasyczną ochroną prawnoautorską, bo brakuje “twórczego wkładu człowieka”. To wpływa na to, czy w ogóle można dochodzić roszczeń dotyczących takiego obrazu.

Jednocześnie rośnie liczba sporów dotyczących datasetów – tego, na czym trenowane są modele. Artyści i fotografowie podnoszą zarzut, że ich prace były użyte do trenowania bez zgody i wynagrodzenia, co w połączeniu z funkcją “naśladowania stylu” może być odczuwane jako pasożytowanie na cudzej twórczości.

Dodatkowo pojawia się problem “style mimicking”: generowania obrazów, które bardzo wyraźnie naśladują styl konkretnego, żyjącego twórcy. Nawet jeśli same obrazy są formalnie “nowe”, to wizerunek artysty jako marki, jego rozpoznawalny styl i potencjał zarobkowy mogą być naruszane przez nadprodukcję tanich imitacji.

Efekt dla praktyka jest taki, że choć często nie dostaniesz od razu pozwu sądowego, możesz spodziewać się sprzeciwu, kryzysu wizerunkowego albo decyzji klienta, by w ogóle nie korzystać z AI w danym projekcie. I wtedy cały “zysk z automatyzacji” znika, a zostaje nerwowe wycofywanie kreacji.

Co twórca powinien zrozumieć, zanim odpali pierwszy prompt do klienta

Przede wszystkim trzeba odróżnić trzy scenariusze:

- użytek prywatny – do nauki, testów, osobistych projektów, bez publikacji komercyjnej,

- portfolio / social media własne – prace pokazowe, autopromocja,

- praca komercyjna dla klienta – kampanie, opakowania, layouty, materiały sprzedażowe.

Im bardziej zbliżasz się do komercji, im większy klient i im większa skala publikacji, tym więcej rzeczy trzeba ustawić: regulaminy narzędzi, licencje, zgody na wizerunek, zasady przechowywania plików. To moment, w którym “jakoś to będzie” przestaje być strategią.

Dobrym nawykiem jest proste pytanie zadawane samemu sobie przed rozpoczęciem pracy: czy ktoś mógłby mieć realny problem z tym, że ten obraz powstał z użyciem AI i na bazie czyjejś twórczości albo danych?. Jeśli odpowiedź brzmi “tak” albo “nie jestem pewien”, czas sięgnąć po regulamin, prawnika lub alternatywę (np. zdjęcie stockowe czy sesję foto).

Druga rzecz: znajomość polityki narzędzi. Nie wszystkie generatory obrazów AI pozwalają na dowolne wykorzystanie komercyjne. Niektóre ograniczają licencję w przypadku darmowych planów, inne wprowadziły specjalne zasady dla branż regulowanych (medycyna, finanse). Zanim pokażesz klientowi wygenerowany layout, dobrze wiedzieć, czy w ogóle wolno go użyć w jego branży.

Przegląd głównych narzędzi: gdzie czyhają różnice w regulaminach i licencjach

Narzędzia wbudowane: Canva, Adobe Firefly, Microsoft Designer, generatory w stockach

Narzędzia z wbudowanym generatorem obrazów AI, takie jak Canva, Adobe Firefly (w Adobe Express, Photoshopie, Illustratorze), Microsoft Designer czy rozwiązania wbudowane w banki zdjęć (Shutterstock, Adobe Stock), często są projektowane z myślą o użytkownikach komercyjnych. To ich duża przewaga: regulaminy są zwykle bardziej “cywilizowane” dla małych biznesów i twórców.

Adobe mocno podkreśla, że Firefly trenowany jest na licencjonowanych danych: Adobe Stock, treściach z licencją open i treściach znajdujących się w domenie publicznej. Dzięki temu zmniejsza się ryzyko, że wygenerowana grafika będzie oparta na czyjejś pracy użytej bez zgody. Dodatkowo część planów zawiera tzw. indemnity – ochronę przed roszczeniami w określonych sytuacjach.

Podobnie banki zdjęć, które oferują “AI-generated content”, starają się czyścić sytuację prawną tak, byś mógł używać wygenerowanych obrazów jak typowych zasobów stockowych. Zwykle oznacza to prawo do komercyjnego użycia, modyfikacji, a czasem też druku na produktach. Trzeba jednak sprawdzić limity (np. liczba wydruków czy zakaz użycia w logotypach).

Canva czy Microsoft w swoich generatorach idą w tę samą stronę: starają się zabezpieczyć użytkownika w ramach rozsądku, w zamian za trzymanie się reguł: bez treści zakazanych, bez naruszeń znaków towarowych, bez wykorzystywania wygenerowanych obrazów w kontekstach, które mogą szkodliwie wpływać na wizerunek osób.

Samodzielne narzędzia: Midjourney, DALL·E, Stable Diffusion, Leonardo AI i inne

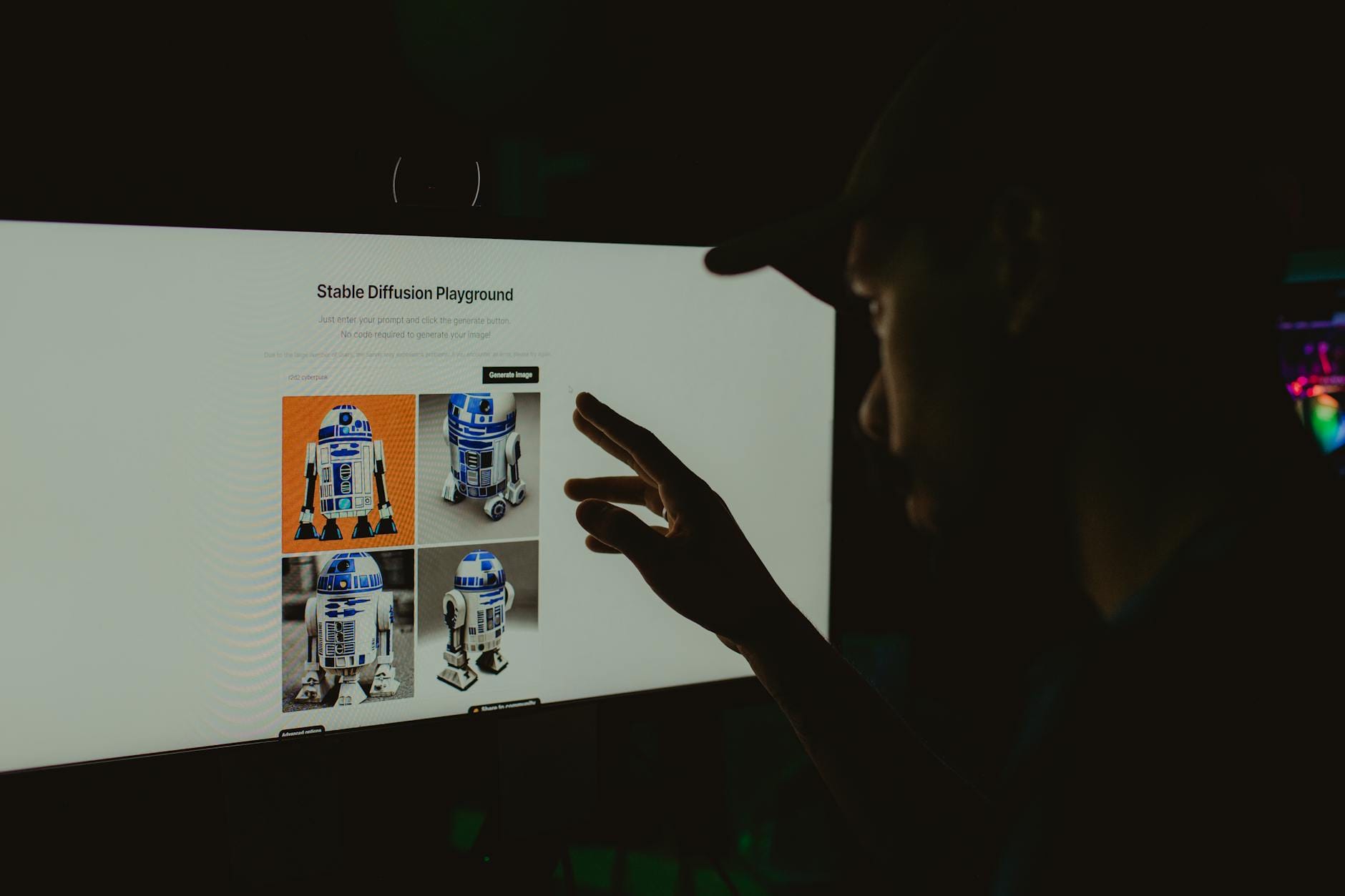

Osobną kategorią są samodzielne generatory obrazów AI: Midjourney (głównie przez Discorda), DALL·E (np. przez interfejs OpenAI lub inne integracje), Leonardo AI, NightCafe oraz modele do samodzielnego uruchamiania, jak Stable Diffusion (lokalnie lub na serwerze).

Tutaj różnice są większe. Część narzędzi jest hostowana w chmurze i ma własny regulamin, w którym określa:

- kto posiada prawa do wygenerowanych obrazów,

- czy możesz używać grafiki komercyjnie (i od jakiego planu),

- jakie treści są zabronione (np. polityczne, erotyczne, medyczne),

- czy obrazy trafiają do galerii publicznej lub datasetów do dalszego trenowania.

Midjourney np. długo miało zasadę, że w planie darmowym obrazy są dostępne publicznie, a pełne komercyjne prawa uzyskuje się dopiero na płatnych subskrypcjach. DALL·E przy korzystaniu przez wybrane interfejsy może mieć inne zasady niż to samo API używane przez dużego klienta korporacyjnego (gdzie dochodzi dodatkowa umowa).

Stable Diffusion jako model open-source ma jeszcze inny profil ryzyka. Sam model może być używany zgodnie z jego licencją, ale wszystko zależy od:

- skąd pochodzi checkpoint (czy nie został wytrenowany na nielegalnie pozyskanych danych),

- jakie dodatkowe modele / LoRA / embedingi do niego wgrywasz,

- jakie treści generujesz i w jakim celu.

Jeśli uruchamiasz Stable Diffusion lokalnie, unikasz problemu przekazywania wrażliwych danych do chmury, ale przejmujesz odpowiedzialność za wszystko inne: zgodność z prawem, datasetami, znakami towarowymi i wizerunkiem osób. W praktyce “wolność” oznacza tu również “pełne ryzyko po twojej stronie”.

Praktyczny nawyk: ekspresowy “check regulaminowy” w 5 minut

Zamiast czytać wielostronicowe regulaminy od deski do deski, opłaca się wyrobić prosty nawyk “5 minut na prawo”, zwłaszcza przy projekcie dla klienta. Skup się na kilku kluczowych punktach:

- Zakres licencji – czy masz prawo do komercyjnego wykorzystania wygenerowanych obrazów? Od jakiego planu? Czy są branże wyłączone?

- Prawa do wyników – kto formalnie jest właścicielem obrazów: ty, narzędzie, czy “brak ochrony autorskiej”?

- Polityka danych – czy twoje prompty i obrazy są używane do trenowania modelu? Czy da się to wyłączyć?

- Treści zakazane – czy to, co planujesz wygenerować (np. medyczne before/after, twarze polityków) nie łamie zasad?

- Publiczność obrazów – czy grafiki automatycznie lądują w galerii publicznej / community?

W praktyce możesz wprowadzić prosty system oznaczania w swoich projektach lub notatkach:

- w briefie dopisz linię: “Źródło grafik AI: [narzędzie], plan: [typ], licencja: [skrócony opis]”,

- w folderach projektowych twórz podfoldery typu “AI – Midjourney – komercja OK” czy “AI – testy, tylko wewnętrznie”,

- w opisie pliku lub w metadanych (tam gdzie narzędzie pozwala) dodawaj krótką notatkę, z jakiego generatora pochodzi obraz.

Pięć minut poświęcone na taki “check regulaminowy” często ratuje przed długimi godzinami nerwowego przepinania kampanii na nowe kreacje, kiedy klient w ostatniej chwili zorientuje się, że sztandarowy visual kampanii ma niejasne pochodzenie.

Prawa autorskie a grafika AI – co twórca powinien mieć “w małym palcu”

Czy obraz wygenerowany AI ma autora i kto nim jest

W wielu systemach prawnych podstawą ochrony jest “twórczość człowieka”. Jeśli obraz powstaje w całości z generatora obrazów AI na podstawie jednego prostego promptu, część prawników twierdzi, że nie ma tu dzieła w rozumieniu prawa autorskiego. W praktyce oznacza to, że trudno rościć wyłączne prawa do takiej pracy – każdy może ją kopiować i modyfikować bez klasycznych sankcji.

Sytuacja zmienia się, gdy wprowadzasz większy wkład twórczy: łączysz wiele wygenerowanych obrazów, retuszujesz je, dodajesz elementy, zmieniasz kompozycję, nadajesz całości unikalny charakter. Im bardziej rezultat odzwierciedla twoje świadome decyzje artystyczne, tym mocniej można argumentować, że powstało utwór chroniony prawem.

Nie ma jednak jednej, żelaznej granicy typu “5 minut retuszu = już jest dzieło”. To raczej spektrum. Dlatego rozsądnie jest założyć, że tam, gdzie bazujesz w 90% na czystym outpucie z generatora, twoja pozycja prawna jest słabsza, niż gdy traktujesz AI jako jedno z narzędzi w szerszym procesie twórczym.

Niektóre narzędzia wprowadzają dodatkowe warstwy: w regulaminie zgadzają się, że jako użytkownik posiadać będziesz prawo do efektów, o ile nie łamiesz zasad. To nie zawsze to samo, co prawo autorskie w sensie ścisłym, ale w wielu sytuacjach wystarczy jako podstawa do komercyjnego wykorzystania.

Ryzyka naruszenia cudzych praw

Największy mit wokół grafiki AI brzmi: “skoro to wygenerował algorytm, to na pewno jest bezpieczne”. Niestety, algorytm nie weźmie za nic odpowiedzialności, a ty – owszem. Ryzyka pojawiają się na kilku poziomach naraz.

Po pierwsze: styl konkretnych artystów. Prompty typu “in the style of [nazwisko]” to prawnicza mina. Samo zainspirowanie się nurtem (np. “art deco, plakat z lat 60.”) jest czymś innym niż próba kopiowania rozpoznawalnego stylu żyjącego twórcy, z nazwiska. Nawet jeśli formalnie w twojej jurysdykcji nie ma “prawa do stylu”, w praktyce ryzykujesz zarzut pasożytowania na cudzej renomie i reputacyjny pożar w social mediach.

Po drugie: znaki towarowe i brandy. Wiele generatorów blokuje słowa typu “Nike”, “Star Wars” czy nazwy popularnych aplikacji, ale nie wszystkie radzą sobie z tym idealnie. Obrazek z butem z charakterystycznym “ptaszkiem” czy telefonem z rozpoznawalnym logo nadal może naruszać cudze prawa. Gdy projektujesz dla klienta, który sam jest marką, mieszanie go wizualnie z obcymi brandami może skończyć się nieprzyjemną korespondencją z działem prawym kogoś zupełnie trzeciego.

Po trzecie: podobieństwo do istniejących prac. Nawet bez wskazywania nazwiska, model potrafi wyprodukować obraz łudząco podobny do istniejącej ilustracji, zdjęcia czy kadru filmowego, jeśli te były w danych treningowych. Ty możesz o tym nie wiedzieć, ale autor oryginału – już tak. Jeśli korzystasz z AI przy tworzeniu layoutów dla dużej kampanii, zlecaj choć podstawowy research wizualny: czy coś zbyt mocno nie przypomina znanych plakatów, kadrów, okładek płyt.

Najprostszy filtr praktyczny: jeśli masz wrażenie “kurczę, to wygląda prawie jak X”, scena z filmu, plakat znanej marki albo styl konkretnego rysownika – poszukaj innego rozwiązania. To uczucie rzadko bywa przypadkowe.

Jak dokumentować swój wkład twórczy

Przy projektach, które mają żyć długo (książka, identyfikacja wizualna, key visual kampanii), warto zbudować sobie prosty “ślad papierowy” pokazujący, że nie jest to tylko jeden klik w generator. To ułatwia rozmowy z klientem, a w razie sporu – z prawnikiem.

Można to zrobić bez wielkiej biurokracji:

- zapisuj kluczowe prompt’y i wersje obrazów (np. w jednym pliku tekstowym lub w notatkach projektu),

- zachowuj etapy obróbki: warstwy w PSD/AI, pliki robocze z kolażami, maskami, poprawkami,

- rób zrzuty ekranu pokazujące proces: kilka iteracji, poprawki, testy kompozycji,

- opisuj krótko decyzje: “tu zmieniono kompozycję, dodano ręcznie liternictwo, usunięto tło AI, wklejono fotografie z sesji klienta”.

Po kilku takich projektach widzisz, gdzie rzeczywiście wkładasz najwięcej twórczości, a gdzie AI robi za “dostawcę szkiców”. To pomaga też uczciwie wyceniać swoją pracę – sprzedajesz koncepcję i odpowiedzialność, nie serię przypadkowych promptów.

Umowy z klientami a grafika AI

Kiedy w grę wchodzą pieniądze i cudza marka, kwestii AI lepiej nie zamiatać pod dywan. Dwa–trzy krótkie zapisy w umowie potrafią uratować relację, gdy nagle ktoś na LinkedInie zacznie wytykać “to przecież obraz z generatora”.

Przy poważniejszych zleceniach możesz:

- ujawnić użycie AI w procesie: jedno zdanie, że w niektórych etapach wykorzystujesz generatory obrazów przy zachowaniu zgodności z prawem i regulaminami narzędzi,

- dodać klauzulę o zakresie odpowiedzialności: np. że nie gwarantujesz uzyskania praw autorskich w rozumieniu ustawowym do elementów wygenerowanych w całości przez AI, ale zapewniasz, że twój wkład nie narusza świadomie cudzych praw,

- ustalić zasady akceptacji ryzyka: czy klient zgadza się na wykorzystanie grafiki AI przy materiałach wysokiego zasięgu (kampania TV, OOH), czy raczej ogranicza się to do prototypów, moodboardów, wersji roboczych,

- zdefiniować procedurę na wypadek sporu: co robicie, jeśli ktoś zgłosi roszczenia (np. szybka wymiana kreacji na wersję bez AI, bez szukania winnego w pierwszych 24 godzinach).

Przy małych zleceniach zamiast dodatkowej umowy czasem wystarczy adnotacja w mailu z ofertą lub w regulaminie współpracy: krótko, konkretnie, bez prawniczego poematu na 5 stron.

Bezpieczeństwo wizerunku, danych i poufnych informacji

Generowanie twarzy: realni ludzie vs. postacie fikcyjne

Twarze to najwrażliwszy obszar generatorów. Pomyłka przy “ładnym portrecie do kampanii” potrafi skończyć się zarzutem wykorzystania wizerunku bez zgody, nawet jeśli nie miałeś pojęcia, że model “podglądał” czyjeś zdjęcie w danych treningowych.

Kilka praktycznych zasad:

- unikać promptów typu “photo of [imię + nazwisko]” przy żyjących osobach – to proszenie się o kłopoty, nawet jeśli narzędzie to blokuje,

- przy ważnych projektach nie bazować na hiperrealistycznych twarzach wygenerowanych wyłącznie przez AI jako “twarzy kampanii”; bezpieczniej jest zrobić sesję foto albo użyć stocka z licencją na wizerunek,

- przy postaciach “na granicy” (np. “przypomina znanego aktora, ale niby nie on”) – lepiej zmienić koncepcję albo przesunąć estetykę w stronę ilustracji, stylizacji, stylu bardziej umownego.

Jeśli klient koniecznie chce użyć swojego zespołu w kreacjach AI (np. “zróbcie nas w wersji anime”), najlepszym rozwiązaniem jest klasyczna zgoda na wizerunek plus narzędzie, które pozwala trenować model na zamkniętych danych (np. w infrastrukturze firmowej). Publiczny generator “z internetu” to kiepskie miejsce na wgrywanie paczki zdjęć zarządu.

Deepfake’i i manipulacja wizerunkiem

Nawet jeśli nie tworzysz typowych deepfake’ów, manipulacja wizerunkiem w AI łatwo może zostać tak odebrana. Portret lekarza przerobiony na mem, zdjęcie polityka w wygenerowanej scenerii skandalu czy logotyp przerobiony na żart – technicznie to tylko kilka kliknięć, ale prawnie i reputacyjnie robi się gorąco.

Jeśli projektujesz coś, co może być odebrane jako obraźliwe, kompromitujące lub politycznie wrażliwe, zadawaj sobie dwa pytania:

- czy osoba/grupa, której dotyczy obraz, ma realną szansę się o nim dowiedzieć (kampania publiczna, social media, viral),

- czy byłbyś gotów obronić ten obraz przed kamerą, pokazując prompt i proces?

Jeżeli na drugie pytanie odpowiedź brzmi “zdecydowanie nie”, to znak, że warto poszukać innej kreacji albo przynajmniej skonsultować się z prawnikiem klienta.

Wgrywanie materiałów klienta do generatorów

Prawdziwe pole minowe to sytuacje, w których nie generujesz “z próżni”, ale wgrywasz zdjęcia, skany, projekty klienta do narzędzia AI, żeby je przerobić. Tu pojawia się kilka problemów naraz:

- poufność – materiały mogą zawierać NDA, tajemnicę przedsiębiorstwa, dane osobowe,

- trenowanie modelu – część narzędzi zastrzega sobie prawo do użycia wgranych plików do dalszego szkolenia algorytmu,

- dostęp osób trzecich – obrazy mogą trafić do historii działań, galerii community, logów serwera.

Przed wrzuceniem czegokolwiek do generatora z chmury, przejdź przez szybką listę kontrolną:

- czy na obrazie są rozpoznawalne twarze? Jeżeli tak, to czy masz na nie zgody i czy naprawdę muszą trafić do zewnętrznego narzędzia?

- czy na grafice widać dokumenty, ekrany, numery, logotypy, które nie powinny trafić poza firmę?

- czy w regulaminie narzędzia możesz wyłączyć użycie danych do trenowania (często wymaga to płatnego planu lub specjalnych ustawień)?

Przy projektach wrażliwych technicznie bezpieczniejszą opcją jest albo lokalne narzędzie (model uruchomiony na twoim komputerze / serwerze klienta), albo dedykowane środowisko firmowe (np. instancja w chmurze zarządzana przez IT klienta). To brzmi dużo poważniej niż “odpalę sobie Canvę”, ale w branżach typu medycyna, bankowość czy ubezpieczenia to coraz częściej standard.

Jak rozpoznawać i minimalizować dane wrażliwe na obrazach

Nawet jeżeli nie pracujesz z medycyną czy finansami, na generowanych i przesyłanych obrazach potrafi się znaleźć zaskakująco dużo danych. Tablice rejestracyjne, nazwiska na identyfikatorach, numery mieszkań, rozkłady biur – wszystko to może ujawniać więcej, niż klient chciałby pokazywać światu.

Dobrą praktyką jest szybki “privacy check” każdego obrazu, który ma wyjść poza wewnętrzny obieg:

- zrób powiększenie newralgicznych miejsc: dokumenty, ekrany, identyfikatory, etykiety,

- sprawdź, czy w tle nie widać prywatnych przestrzeni (np. mieszkanie klienta, dzieci na zdjęciach rodzinnych w ramkach),

- jeśli generujesz scenerie “podobne do biura klienta”, zadbaj, by były ogólne, bez mapy rozmieszczenia stanowisk czy planu ewakuacyjnego na ścianie.

Generator AI sam z siebie zwykle nie “doklei” naprawdę istniejących danych klienta, ale gdy mieszasz zdjęcia realne z generowanymi elementami, łatwo przeoczyć szczegół, który nie powinien w ogóle wyjść poza firmę.

Korzystanie z AI przy materiałach medycznych, finansowych i z innych branż regulowanych

W branżach regulowanych poprzeczka bezpieczeństwa jest wyżej z definicji. Jeśli robisz grafiki dla kliniki, banku, firmy farmaceutycznej czy ubezpieczeniowej, każdy obraz staje się potencjalnie dokumentem, który ktoś może interpretować zbyt dosłownie.

Od strony praktycznej:

- przy medycznych “before/after” unikaj realistycznych twarzy wygenerowanych losowo – klient może mieć obowiązek podpisywać zgody pacjentów, a ty nagle prezentujesz “pacjenta widmo”, którego nie da się zidentyfikować, ale którego ktoś może wziąć za realną osobę,

- w materiałach finansowych grafiki typu “ekran aplikacji bankowej” twórz tak, by nie przypominały istniejącego interfejsu konkretnego banku i nie zawierały realnych danych (np. numerów rachunków, sald),

- w farmacji unikaj łączenia AI z autentycznymi zdjęciami opakowań leków, jeśli generator może dokładać lub modyfikować nazwy, dawki, ostrzeżenia – to już nie tylko prawo autorskie, ale i przepisy dotyczące reklamy produktów leczniczych.

Dobry test: czy ten obraz mógłby kogoś realnie wprowadzić w błąd co do stanu zdrowia, posiadanego produktu finansowego albo rekomendowanego leczenia? Jeśli tak, lepiej przeprojektować koncepcję, niż później tłumaczyć się regulatorowi, że “to tylko AI, tak wyszło”.

Organizacja pracy: bezpieczeństwo od briefu po archiwizację

Bezpieczeństwo grafiki AI nie kończy się na kliknięciu “pobierz obraz”. Problem pojawia się także w tym, co dzieje się przed i po.

Już na etapie briefu z klientem można wprowadzić dwa proste elementy:

- jedno pytanie: “czy są dane / motywy, których absolutnie nie używamy w AI?” (np. twarze pracowników, wnętrza fabryk, realne ekrany systemów),

- jedną linijkę w notatkach: “AI: zakres dopuszczalnego użycia” – tylko koncepcje / finalne grafiki / brak użycia.

Na końcu procesu – przy archiwizacji – przydaje się prosty podział folderów: osobno “AI – materiały wewnętrzne” (szkice, moodboardy, testy stylu), osobno “AI – materiały opublikowane” (finały zatwierdzone przez klienta). Dzięki temu po czasie łatwiej wrócić do danego projektu i sprawdzić, co dokładnie trafiło do ludzi, a co było tylko fajnym eksperymentem.

To wszystko brzmi jak dodatkowa praca, ale po kilku projektach staje się rutyną – jak zapisywanie warstw czy opisywanie plików. A kiedy przychodzi trudne pytanie od klienta albo jego działu prawnego, taki uporządkowany proces potrafi oszczędzić wielu nieprzyjemnych maili i telefonów.

Bezpieczna współpraca z klientem przy projektach z użyciem AI

Przy klasycznych projektach graficznych granice odpowiedzialności są w miarę jasne: jest brief, umowa, finalne pliki. Przy AI robi się ciekawiej, bo oprócz “co wyszło” trzeba czasem wytłumaczyć “jak do tego doszło”.

Jak komunikować użycie AI, żeby nie straszyć i nie wprowadzać w błąd

Nie każdy klient lubi, gdy słowo “sztuczna inteligencja” pojawia się w pierwszym zdaniu rozmowy. Z drugiej strony całkowite przemilczenie wykorzystania AI też potrafi się zemścić, szczególnie gdy w firmie klienta ktoś śledzi wytyczne compliance.

Przydaje się prosty, szczery sposób komunikacji:

- nie mów: “wszystko zrobi AI”, tylko raczej: “używam generatorów jako narzędzia pomocniczego” – tak jak renderera 3D czy stocków,

- pokazuj, na którym etapie pojawia się AI: koncepcje, moodboardy, warianty stylu, a gdzie nadal pracujesz ręcznie (retusz, skład, dopasowanie do brandu),

- jasno oznaczaj projekty testowe: “wersja eksperymentalna z AI – do oceny kierunku, nie jako gotowy materiał”.

Przy pierwszym projekcie dla nowego klienta dobrze jest zapytać wprost: czy firma ma wewnętrzne zasady dotyczące AI? W wielu większych organizacjach istnieją już dokumenty typu “AI policy”, tylko nikt o nich nie wspomina, dopóki ktoś nie zada pytania.

Zapisy w umowie: co dodać, gdy w grę wchodzi AI

Umowy ramowe i proste zlecenia często nie nadążają za tematami AI. Kilka dodatkowych zdań potrafi oszczędzić sporów w przyszłości.

Przy projektach z generatorami obrazów rozsądnie jest doprecyzować w umowie m.in.:

- zakres użycia AI – czy używasz jej tylko na etapie koncepcji, czy również w finalnych materiałach,

- odpowiedzialność za wybór narzędzi – czy klient akceptuje konkretne platformy (np. Midjourney, DALL·E, lokalny Stable Diffusion),

- kwestię praw autorskich – że finalny projekt jest kompozycją, obróbką, aranżacją, do której przenosisz prawa, nawet jeśli składa się z elementów AI + własnej pracy,

- zasady pracy na materiałach klienta – co możesz wgrywać do narzędzi, a czego nie (np. wykluczenie dokumentów wewnętrznych, ekranów systemów, zdjęć z wnętrz fabryk).

Nie trzeba od razu pisać regulaminu godnego korporacyjnego działu prawnego. Wystarczy, że obie strony mają spisane w dwóch–trzech zdaniach: “jak, gdzie i do czego używamy AI” oraz co się dzieje, jeśli po czasie wyjdzie na jaw, że konkretne narzędzie zmieniło regulamin na mniej korzystny.

Transparentność wobec odbiorców końcowych

Część klientów zaczyna wymagać oznaczenia, że materiał powstał z wykorzystaniem AI – szczególnie w branżach wrażliwych i w kampaniach reputacyjnych. Dobrze mieć kilka gotowych formuł, które można zaproponować:

- krótkie oznaczenie w stopce: “grafika częściowo wygenerowana z użyciem narzędzi AI”,

- adnotację w prezentacji czy raporcie: “dla wizualizacji użyto generatorów obrazów AI, obrazy mają charakter poglądowy”,

- oznaczenia w plikach źródłowych (np. warstwa nazwana “AI base” w PSD), żeby po roku nikt nie zastanawiał się, skąd wziął się konkretny element.

To nie tylko kwestia etyki. Przy coraz częstszych dyskusjach regulacyjnych dobrze móc pokazać, że materiał nie udaje bezrefleksyjnie “prawdziwego zdjęcia rzeczywistości”.

Bezpieczne workflow: od promptu po pliki źródłowe

Generator grafiki to tylko jeden przystanek w całym łańcuchu – równie łatwo popełnić błąd przy eksporcie, opisywaniu plików czy udostępnianiu moodboardów.

Projektowanie promptów z myślą o bezpieczeństwie

Prompt to nie tylko opis estetyki; to również miejsce, w którym można przypadkiem upchnąć dane, które nie powinny trafić na serwery zewnętrzne. Zbyt szczery opis sytuacji klienta potrafi zdradzić więcej niż sam wygenerowany obraz.

Dobrą praktyką jest “odchudzanie” promptu z informacji, które zdradzają:

- nazwy firm, produktów, wewnętrznych systemów,

- prawdziwe nazwiska (poza historycznymi postaciami publicznymi),

- szczegóły lokalizacji (dokładne adresy, numery oddziałów, nazwy klinik, marek szpitali),

- dane finansowe czy specyficzne parametry projektów (np. limity kredytowe, dokładne ceny kontraktów).

Zamiast “dashboard aplikacji bankowej X z widocznym limitem 10 000 PLN” lepiej użyć neutralnego: “generic mobile banking dashboard UI, no real data, no specific brand”. To nadal daje sensowny efekt wizualny, ale nie odsłania nic konkretnego o kliencie.

Nazywanie i wersjonowanie plików bez wycieków

Mało kto lubi się zastanawiać nad nazwami plików, dopóki nie trzeba czegoś odnaleźć po roku. W kontekście AI i bezpieczeństwa dochodzi jeszcze jeden aspekt: nazwy też mogą ujawniać więcej, niż trzeba.

Przydatne zasady:

- unikaj w nazwach plików pełnych nazw klientów i projektów poufnych; lepiej użyć skrótów czy wewnętrznych kodów,

- nie zapisuj promptów w nazwie pliku, jeśli zawierają dane klienta – przenieś je do opisów w metadanych lub osobnego dokumentu,

- dla ułatwienia audytu dodaj prosty znacznik, np. “AI” w nazwie wariantu roboczego:

campagne_X_visual_AI_v03.png.

Przy większych projektach sensownie jest prowadzić krótki log: który obraz powstał w jakim narzędziu, z jakiego promptu, kiedy. Nie chodzi o kronikę życia twórcy, tylko o możliwość udowodnienia, że grafika nie jest np. przeróbką cudzego logo czy zdjęcia.

Udostępnianie plików i galerii – czego unikać

Kolejne pole minowe to wszelkie “galerie społecznościowe”, automatyczne portfolio w chmurze czy publiczne linki do plików. Wygenerowany test do klienta może po chwili wisieć w publicznej przestrzeni narzędzia, choć nikt nie miał takiego zamiaru.

Przy pracy z klientami komercyjnymi dobrze jest:

- sprawdzić ustawienia widoczności w używanym narzędziu – czy obrazy zapisują się domyślnie jako publiczne, prywatne, czy “unlisted”,

- ograniczać udostępnianie poprzez linki bez hasła, szczególnie gdy w obrazach występują rzeczywiste wnętrza lub produkty przed premierą,

- przy narzędziach z feedem społecznościowym (jak niektóre boty na Discordzie) generować wrażliwe rzeczy w trybie prywatnym lub w osobnej, zamkniętej instancji.

Dobrze też założyć, że wszystko, co trafiło do publicznej galerii, może zostać zarchiwizowane przez kogoś innego – nawet jeśli po chwili usuniesz materiał. To nie paranoja, to rzeczywistość internetu.

Bezpieczne łączenie grafiki AI z innymi zasobami

Rzadko kiedy finalny projekt to “czyste AI”. Na ogół mieszają się tam zdjęcia stockowe, własne fotografie, elementy UI, logo, ikony i ręczne ilustracje. Z prawnego i wizerunkowego punktu widzenia mieszanka bywa bardziej problematyczna niż sam generator.

Łączenie AI ze stockami i gotowymi assetami

Większość marek korzysta równolegle z bibliotek stockowych. Problem zaczyna się wtedy, gdy wrzucasz stocka do AI albo gdy generatorem próbujesz “dociągnąć” brakujący kadr do zestawu zdjęć.

Przy takim miksie pojawia się kilka ryzyk:

- warunki licencji stocka mogą wprost zakazywać użycia pliku jako danych treningowych lub wejścia do modelu,

- gdy nadpiszesz stock AI-em (np. dodając elementy, zmieniając scenerię), może być trudno udowodnić, że nadal mieścisz się w licencji – szczególnie przy zdjęciach z klauzulą dotycząca wizerunku,

- mieszanie elementów z różnych źródeł (AI + inne stocki) w jednym pliku bywa niejasne pod kątem tego, które fragmenty możesz legalnie dalej sublicencjonować.

Bezpieczniejszy schemat pracy wygląda tak:

- Najpierw decydujesz, które elementy będą AI, a które stockiem,

- dla stocków wybierasz pakiety z licencją dopuszczającą kompozycje i reklamy,

- na końcu składasz wszystko lokalnie w klasycznym edytorze grafiki (Photoshop, Affinity, Figma), bez ponownego “przepuszczania” całości przez generator.

Jeżeli klient upiera się przy “dopieprzeniu efektów AI” na stockach, dobrym kompromisem jest użycie lokalnych narzędzi AI (np. rozszerzeń do programów graficznych, które nie wysyłają plików na zewnątrz), a nie publicznego API w chmurze.

AI jako element identyfikacji wizualnej marki

Narzędzia AI kuszą, żeby “wyklikać” cały key visual marki jednym kliknięciem. Problem w tym, że identyfikacja oparta w 100% na generatywnym modelu jest trudniejsza do obrony prawnie, a do tego łatwiej ją podrobić.

Bezpieczniejsza strategia to traktowanie AI jako inspiratora i generatora szkiców, a nie jako jedynego źródła brandu. Sensowny schemat:

- użyj generatora do wygenerowania kilkudziesięciu wariantów stylu (kolory, faktury, metafory wizualne),

- wybierz kierunki, które są spójne z charakterem marki, i przeprojektuj je ręcznie – redukując przypadkowe elementy modelu,

- zadbaj, by kluczowe elementy identyfikacji (logo, podstawowe ikony, kluczowy pattern) powstały “od zera”, a nie wyłącznie jako wynik promptu.

Dzięki temu nawet jeśli konkurencja użyje tego samego modelu i zbliżonych promptów, uzyska raczej podobny klimat niż trudną do odróżnienia kopię identyfikacji. To trochę jak z fontami: sam wybór popularnego kroju to za mało, by mieć “unikatowy branding”.

Kontrola jakości: błędy, które wychodzą dopiero po publikacji

AI lubi halucynować drobiazgi: dziwne napisy na budynkach, dodatkowe palce, błędne symbole, przypadkowe skojarzenia kulturowe. Na małym podglądzie wygląda to świetnie, a dopiero na billboardzie ktoś zauważa, że tekst na szyldzie w nieznanym języku oznacza coś, czego klient nie chce na swojej kampanii.

Zanim grafika wyjdzie w świat, dobrze jest przejść prosty test jakości:

- powiększenie 100–200% i “skan” kadru od lewej do prawej – czy nie ma dodatkowych kończyn, losowych artefaktów, dziwnych cieni,

- sprawdzenie wszystkich widocznych napisów – również tych w tle, na plakatach, ekranach, tabliczkach,

- krótka konsultacja z osobą spoza projektu – świeże oko często wyłapie coś, co autorowi wydaje się “oczywiste”.

Jeżeli pracujesz z rynkami zagranicznymi, sensownie jest poprosić lokalny zespół (lub tłumacza) o rzut oka na symbolikę i skojarzenia. Wystarczy jedna niefortunna ikona czy kolor, by w konkretnym kraju odebrano przekaz zupełnie inaczej, niż planował dział marketingu.

Budowanie własnych standardów pracy z grafiką AI

Regulacje i regulaminy narzędzi będą się zmieniać jeszcze latami. Zamiast za każdym razem zaczynać od zera, łatwiej oprzeć się na własnych, prostych zasadach i aktualizować je krok po kroku.

Mini–polityka AI dla freelancera lub małego studia

Nawet jednoosobowa działalność może mieć wewnętrzną politykę AI – choćby w formie kilkustronicowego dokumentu, do którego zaglądasz przy większych projektach. Nie musi to być wcale poważny segregator w trzech kopiach; wystarczy spójny zestaw reguł.

Taki dokument może zawierać m.in.:

- listę narzędzi “dozwolonych” i “zakazanych” (np. tych, które nie pozwalają wyłączyć użycia danych do treningu),

- jasne zasady: czego nigdy nie wrzucasz do generatorów (ekrany systemów, skany umów, dokumenty medyczne, projekty przed premierą),

- procedurę “panic button” – co robisz, jeśli przez pomyłkę wgrasz do narzędzia coś poufnego (kontakt z supportem, usunięcie konta, informacja do klienta),

- schemat dokumentowania projektów AI: gdzie trzymasz prompty, wersje robocze, finalne pliki i notatki.

Najczęściej zadawane pytania (FAQ)

Czy mogę legalnie używać obrazów z generatora AI w projektach komercyjnych?

W wielu przypadkach tak, ale zależy to od regulaminu konkretnego narzędzia i od tego, na jakim planie działasz (darmowym czy płatnym). Część generatorów zezwala na pełne, komercyjne wykorzystanie wygenerowanych grafik, inne ograniczają licencję, np. tylko do użytku osobistego lub promocyjnego, ale nie na produktach do sprzedaży.

Przy dużych kampaniach lub pracy dla znanych marek nie opieraj się na domysłach. Sprawdź sekcje „Licensing”, „Commercial use” lub „Terms of use” w narzędziu i zrób prostą notatkę: z jakiego generatora korzystasz, na jakim planie i z jakimi ograniczeniami. To często wystarcza, by uciąć późniejsze dyskusje z klientem czy działem prawnym.

Czy obrazy wygenerowane przez AI są objęte prawem autorskim?

W wielu krajach obraz stworzony w całości przez AI nie ma klasycznej ochrony prawnoautorskiej, bo brakuje „autora” w rozumieniu prawa. W praktyce oznacza to, że trudniej jest egzekwować wyłączne prawa do takiej grafiki tak, jak do tradycyjnej ilustracji czy zdjęcia.

Dlatego w projektach, gdzie wyjątkowość i kontrola nad prawami są kluczowe (np. identyfikacja wizualna, logotyp, key visual dużej kampanii), lepiej traktować AI jako narzędzie pomocnicze: do szkiców, moodboardów, koncepcji. Ostateczną wersję warto dopracować ręcznie lub z ilustratorem/fotografem, żeby nie opierać całej strategii na „szarej strefie” prawa.

Czy mogę generować obrazy „w stylu” konkretnego artysty lub marki?

Technicznie da się to zrobić jednym promptem, ale prawnie i etycznie to grząski grunt. Naśladowanie wyraźnie rozpoznawalnego stylu żyjącego twórcy może zostać odebrane jako pasożytowanie na jego marce osobistej. W przypadku znanych marek dodatkowo wchodzą w grę znaki towarowe i ochrona wizerunku brandu.

Bezpieczniejsza praktyka to proszenie o styl opisowy, a nie personalny: zamiast „in the style of X” użyj „akwarelowy, miękkie światło, pastelowa paleta, minimalizm”. Efekt często będzie bardzo podobny, a jednocześnie nie dotykasz tak bezpośrednio cudzego nazwiska i rozpoznawalnego „brandu artystycznego”.

Jak bezpiecznie używać generatorów obrazów AI w pracy dla klientów?

Najprostszy schemat to trzy kroki: po pierwsze, jasno rozdziel projekty: testowe, portfolio i komercyjne. Po drugie, dla projektów komercyjnych wybierz narzędzia z przejrzystą licencją i – jeśli to możliwe – z dodatkowymi zabezpieczeniami prawnymi (jak Adobe Firefly czy generatory w stockach). Po trzecie, ustal wewnętrzne zasady: czego nie generujesz (np. logotypów, twarzy znanych osób, imitacji stylów konkretnych artystów).

Dobrą praktyką jest też poinformowanie klienta, że w procesie korzystasz z AI, szczególnie przy dużych budżetach. Zdarza się, że klient ma własne regulacje wewnętrzne i z góry zakazuje AI w materiałach, które wychodzą na zewnątrz – lepiej dowiedzieć się o tym na briefingu niż przy akceptacji finalnych kreacji.

Jakie narzędzia AI są najbezpieczniejsze pod kątem licencji i praw autorskich?

Relatywnie bezpieczne są narzędzia stworzone z myślą o zastosowaniach komercyjnych: Adobe Firefly (w produktach Adobe), Canva z generatorem obrazów, Microsoft Designer czy generatory wbudowane w banki zdjęć (np. Adobe Stock, Shutterstock). Zwykle bazują one na licencjonowanych zbiorach danych i oferują jasne zasady użycia oraz dodatkowe zabezpieczenia dla użytkowników biznesowych.

Samodzielne narzędzia typu Midjourney, Stable Diffusion czy Leonardo AI dają dużą swobodę twórczą, ale wymagają większej uważności przy czytaniu regulaminów i samodzielnej oceny ryzyk (styl, podobieństwo do marek, wizerunek osób). To świetne „laboratoria kreatywne”, ale do kampanii dużego klienta lepiej korzystać z rozwiązań z bardziej dopracowaną polityką licencyjną.

Czy muszę informować klienta, że użyłem AI do stworzenia grafiki?

Prawnie nie zawsze jest taki obowiązek, ale biznesowo często się to opłaca. Coraz więcej firm ma własne polityki dotyczące AI (np. zakaz generowania wizerunków ludzi, zakaz AI w branżach regulowanych), więc ukrywanie tego faktu potrafi skończyć się dużym nieporozumieniem, gdy projekt trafi w ręce prawnika.

Najrozsądniejsze podejście: ustalić temat na etapie briefu. Możesz zaproponować: „Część koncepcji przygotuję z użyciem AI, a potem je dopracuję – czy to jest dla was ok?”. Dwie minuty rozmowy oszczędzają później godzin tłumaczenia, skąd wzięła się nagle „magicznie szybka” kampania.

Jak odróżnić „bezpieczne bawienie się AI” od ryzykownego użycia w biznesie?

Prosty filtr to pytanie: „Co się stanie, jeśli ktoś zgłosi zastrzeżenia do tego obrazu?”. Jeśli odpowiedź brzmi „usunę post z prywatnego Instagrama”, ryzyko jest niewielkie. Jeśli mówimy o kampanii outdoorowej, opakowaniu produktu albo key visualu międzynarodowej marki – stawka rośnie dramatycznie.

Dlatego:

- do nauki i testów używaj AI bez stresu, ale nie przenoś tych plików 1:1 do kampanii,

- w portfolio wyraźnie oznacz prace częściowo lub w całości wygenerowane przez AI,

- w projektach komercyjnych trzymaj się narzędzi z jasną licencją, unikaj „stylu X” i elementów mogących naruszać cudze znaki towarowe lub wizerunek.

To rozdzielenie trzech trybów pracy jest prostą „poduszką bezpieczeństwa” dla twojej twórczości i relacji z klientami.

Najważniejsze wnioski

- Generatory obrazów AI stały się normalnym narzędziem w pracy twórczej, ale wraz z wygodą przyspieszania moodboardów, miniaturek czy slajdów wchodzą realne ryzyka prawne, wizerunkowe i biznesowe.

- Źródłem wielu konfliktów nie jest “zła wola”, tylko brak procedur: ktoś na szybko generuje grafikę, nie czyta regulaminu, powiela cudzy styl lub elementy znanej marki i nagle projekt łudząco przypomina kampanię konkurencji.

- Modele generatywne nie kopiują plików 1:1, ale uczą się abstrakcyjnych wzorców; mimo to przy charakterystycznych stylach, znakach towarowych czy schematach mogą stworzyć obraz na tyle podobny, że rodzi to pytania o prawa autorskie i etykę.

- Prawo nie nadąża za AI: obrazy wygenerowane w całości przez model często nie mają klasycznej ochrony autorskiej, a równocześnie rośnie spór o to, że dataset do trenowania powstał z cudzych prac użytych bez zgody i wynagrodzenia.

- “Style mimicking”, czyli naśladowanie konkretnego rozpoznawalnego twórcy (“zrób mi to jak X”), może uderzać w jego markę osobistą i zarobki, a dla agencji oznacza ryzyko kryzysu wizerunkowego – nawet jeśli formalnie nikt nie składa pozwu.

- Trzeba świadomie rozróżniać trzy scenariusze: zabawę i naukę na własny użytek, autopromocję w portfolio/socialach oraz projekty komercyjne dla klienta – im bliżej komercji i dużej skali, tym więcej formalności, których nie da się “odbębnić później”.

Bibliografia i źródła

- Generative AI and copyright. World Intellectual Property Organization – Przegląd wyzwań prawnoautorskich związanych z generatywną AI

- Generative AI and the law. European Union Intellectual Property Office (2023) – Analiza skutków prawnych generatywnej AI w UE

- Copyright protection for works containing AI-generated material. U.S. Copyright Office (2023) – Stanowisko urzędu USA w sprawie ochrony utworów z udziałem AI

- Artificial Intelligence and Intellectual Property. UK Intellectual Property Office (2022) – Raport o relacji między AI a prawami własności intelektualnej

- Guidance on the use of AI in creative industries. UNESCO – Wytyczne etyczne dla twórców korzystających z narzędzi AI

- AI and data protection. European Data Protection Board (2022) – Wskazówki o ochronie danych osobowych przy korzystaniu z systemów AI

- Responsible practices for generative AI in creative work. OECD (2023) – Rekomendacje odpowiedzialnego użycia generatywnej AI w biznesie

- Terms of Use – Adobe Firefly. Adobe – Zasady licencjonowania i dane treningowe dla generatora obrazów Firefly

- Responsible AI Standard. Microsoft (2022) – Zasady projektowania i użycia narzędzi AI, w tym generowania obrazów